Cloudflare AI Gateway 是什麼?企業導入 AI 必備的流量管理與安全控管架構

隨著 ChatGPT、Claude 與 Gemini 等大型語言模型(LLM)逐步進入企業應用場景,AI 導入門檻已大幅降低。然而,當 AI 從實驗性工具轉變為企業核心服務時,新的管理挑戰也隨之浮現,包括成本難以預測、機密資料外洩風險,以及多模型整合的複雜度。

隨著 ChatGPT、Claude 與 Gemini 等大型語言模型(LLM)逐步進入企業應用場景,AI 導入門檻已大幅降低。然而,當 AI 從實驗性工具轉變為企業核心服務時,新的管理挑戰也隨之浮現,包括成本難以預測、機密資料外洩風險,以及多模型整合的複雜度。

在這樣的背景下,「AI Gateway」逐漸成為企業 AI 架構中不可或缺的關鍵組件。

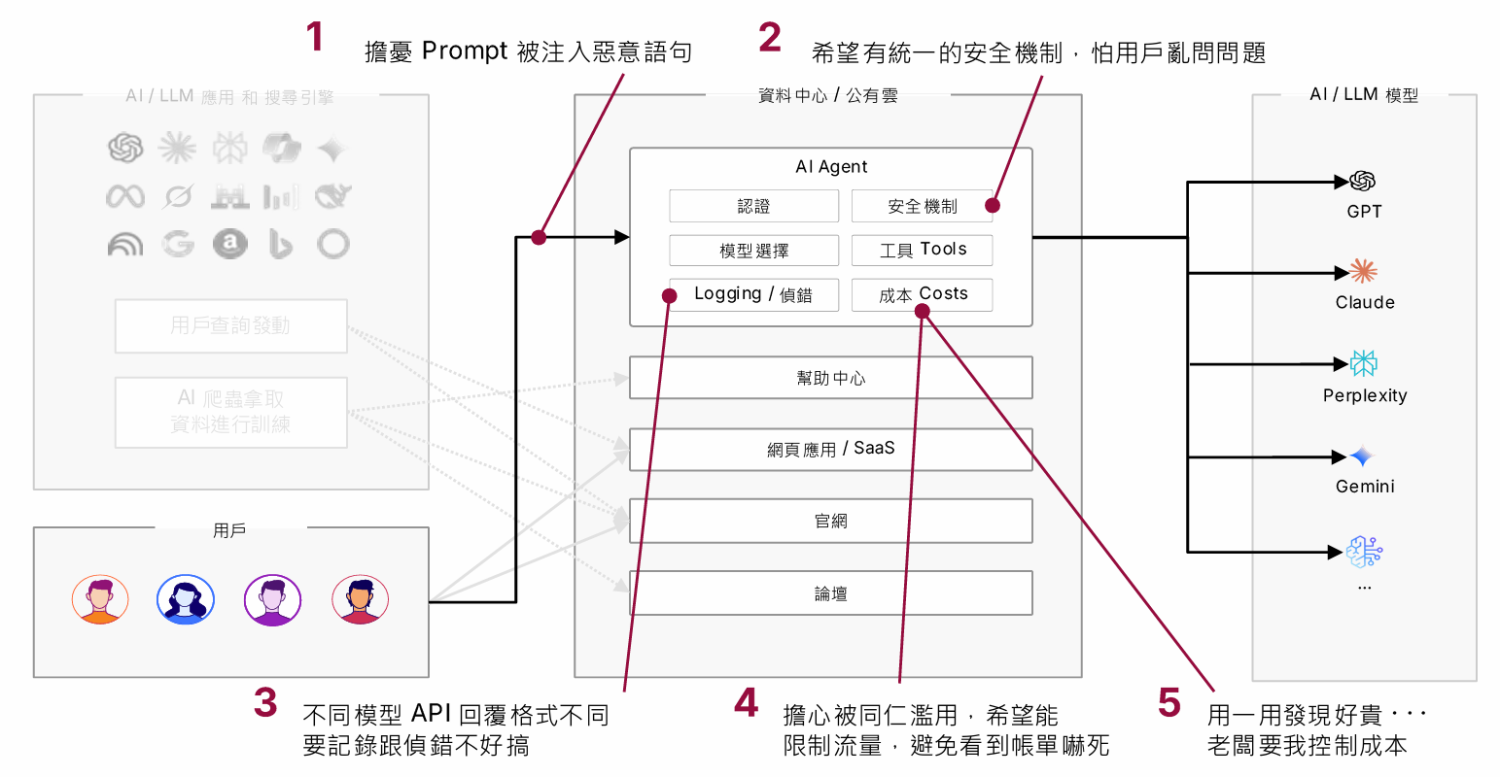

為什麼企業需要 AI Gateway?三大核心痛點

多數企業在初期僅是單純串接 AI API,但隨著使用規模擴大,通常會面臨以下三類問題:

成本失控與不可預測性

AI 服務多以 Token 計費,當應用正式上線後,請求量往往成長迅速。若缺乏有效的監控與限制機制,成本將難以預估,甚至在短時間內大幅增加,影響整體 IT 預算規劃。

資安風險與資料外洩(DLP)

在日常使用過程中,員工或系統可能無意間將客戶資料、內部文件或其他敏感資訊輸入 AI 模型。若沒有中介層進行檢測與控管,這些資料將直接傳送至外部服務,進而產生合規與資安風險。

多模型整合帶來的維運負擔

不同模型(如 GPT、Claude、Gemini)在 API 格式、認證方式與回應結構上存在差異。當企業需要同時使用多個模型,或未來進行模型切換時,系統整合與維運成本將顯著提高。

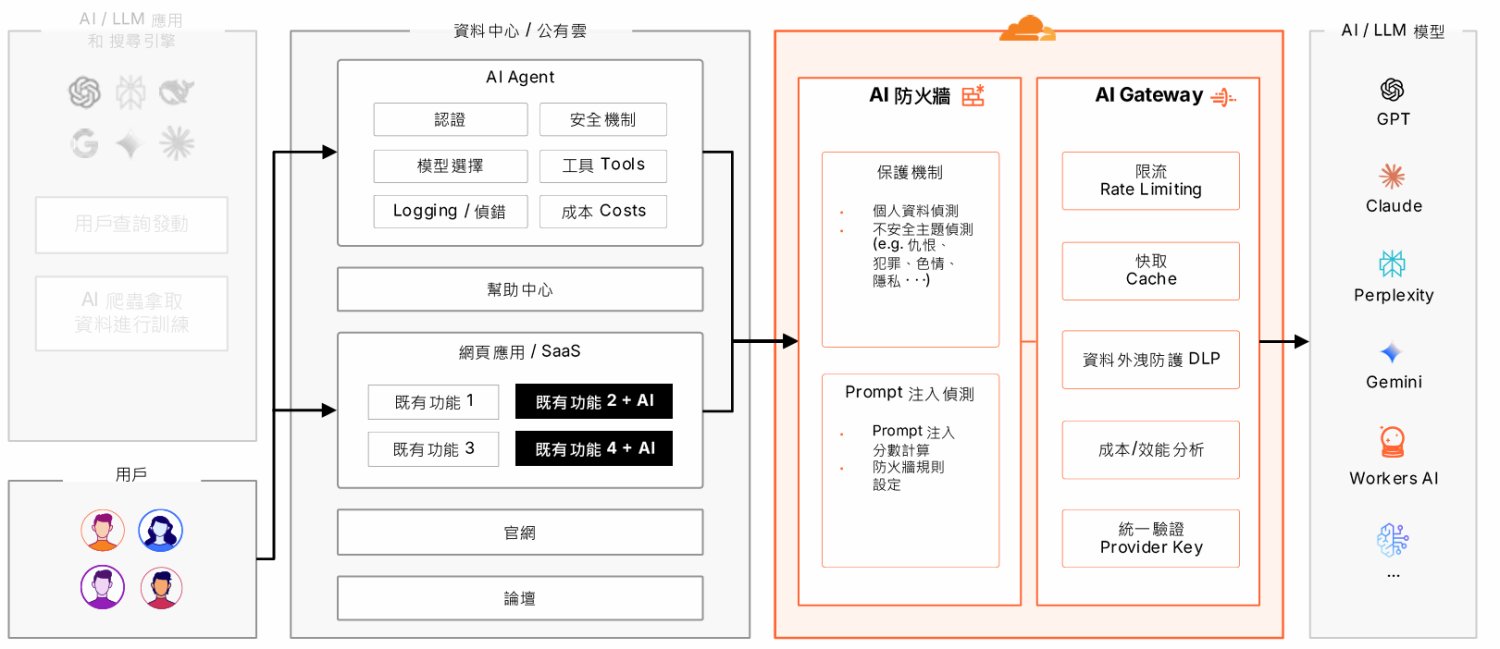

Cloudflare AI Gateway:AI 時代的流量治理中心

Cloudflare AI Gateway 位於應用程式與各類 LLM 服務之間,扮演統一管理與控制的中介層。所有 AI 請求會先經過 Gateway,再轉發至實際模型服務。

從 Cloudflare 的產品設計來看,其核心不僅是 API 管理,而是對 AI 請求資料流(traffic flow)的監控與控制。無論模型部署於地端或雲端環境,皆可透過單一入口進行統一管理,讓企業在架構上建立清晰且可控的 AI 使用邏輯。

AI Gateway 如何運作?

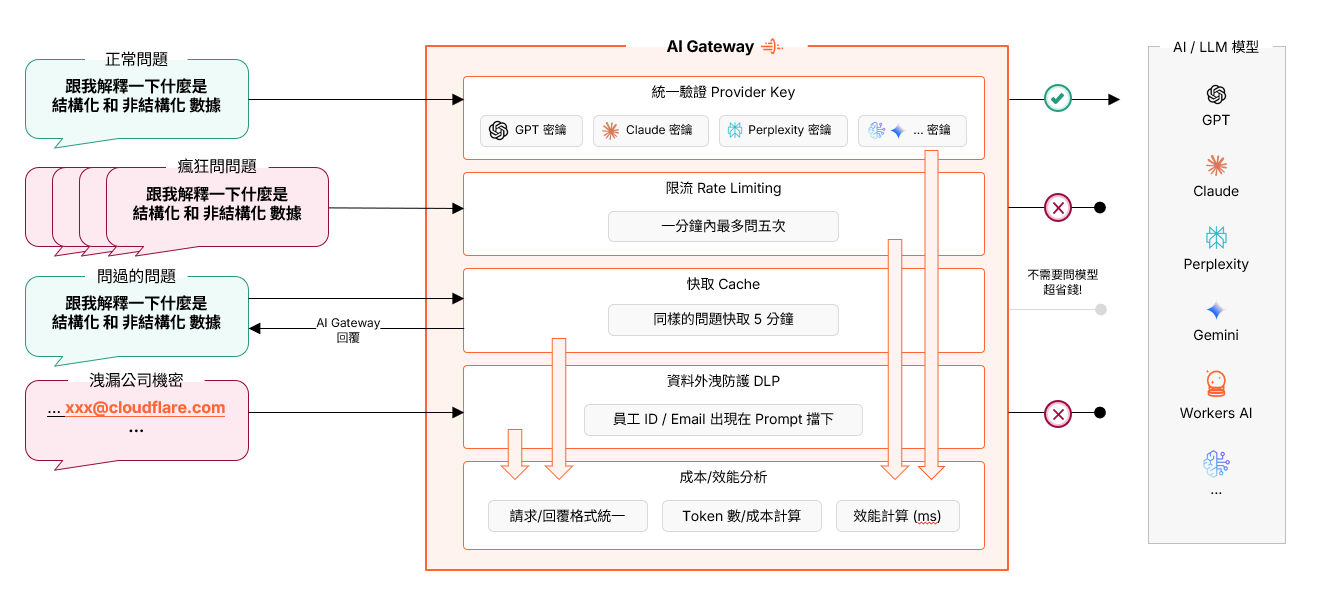

從實際架構來看,AI Gateway 的運作流程可分為以下幾個階段:

當使用者或應用程式發出 AI 請求時,請求會先進入 AI Gateway,而非直接送往模型。Gateway 會在轉發前執行一系列控管機制,例如統一認證、速率限制、快取判斷,以及輸入內容檢測等。

在確認請求符合規則後,系統才會將請求轉送至對應的 LLM(如 GPT、Claude 或 Gemini)進行推論。模型回傳結果後,回應同樣會經過 Gateway,並記錄相關資訊,包括 Token 使用量、回應時間與成本數據。

透過這樣的設計,企業可以在單一層中同時完成流量控制、成本分析與安全防護,使原本分散的 AI 使用行為轉變為可視且可管理的系統。

Cloudflare AI Gateway 核心功能與優勢

多模型統一入口

透過單一 API,即可整合 OpenAI、Anthropic、Google 等主流模型,降低開發複雜度,同時保留模型選擇的彈性。

成本分析與可視化

系統可記錄每一筆請求的 Token 使用量、回應時間與成本,讓企業能夠分析使用狀況並進行優化,而非僅被動承擔費用。

智慧快取(Caching)

針對高重複性的請求,系統可直接回傳快取結果,減少模型呼叫次數,達到降低成本與提升回應速度的效果。

速率限制(Rate Limiting)

可針對不同使用者或應用設定請求上限,避免濫用或異常流量造成成本與系統負擔。

資料外洩防護(DLP)

透過對輸入內容的檢測機制,可識別並阻擋敏感資訊(如個資或機密內容),降低資料外洩風險。

此外,在 AI 安全層面,也需考量 Prompt Injection 等新型攻擊,避免模型被誘導輸出不當或敏感資訊。

以下整理 Cloudflare AI Gateway 的核心功能與其對應解決的問題:

| 功能 | 說明 | 解決問題 |

|---|---|---|

| 多模型整合 | 單一 API 存取多種 LLM | 降低開發與整合複雜度 |

| 成本分析 | 記錄 Token、延遲與費用 | 解決成本不可預測問題 |

| 快取(Cache) | 回傳重複請求結果 | 降低成本並提升速度 |

| 速率限制 | 控制請求頻率 | 防止濫用與成本暴增 |

| 資料外洩防護(DLP) | 檢測敏感資訊 | 降低資料外洩風險 |

AI Gateway 與直接串接 AI API 的差異

在未導入 AI Gateway 的情況下,企業通常會直接串接各家模型 API。這種方式在初期導入時相對快速,但當使用規模擴大後,可能會面臨以下問題:

- 成本缺乏統一監控機制,難以預測實際支出

- 不同模型之間的 API 格式與回應結構不一致,增加整合與維運難度

- 缺乏集中式的使用控管,無法有效限制請求頻率或追蹤使用行為

- 無法對輸入內容進行檢測,提升資料外洩風險

這些情境正是企業在實務導入 AI 時常見的挑戰。

相較之下,AI Gateway 透過建立統一的中介層,使企業能在請求進入模型前完成控管,進一步提升整體系統的可管理性與安全性。

以下比較直接串接 AI API 與導入 AI Gateway 的差異:

| 面向 | 直接串接 AI API | 使用 AI Gateway |

|---|---|---|

| 成本管理 | 無統一監控,難以預測支出 | 可記錄 Token 與成本,進行分析與優化 |

| API 管理 | 各模型 API 格式不一致 | 統一入口管理多模型 |

| 使用控管 | 難以限制請求頻率 | 可設定 Rate Limiting 控制使用行為 |

| 資料安全 | 無法檢測輸入內容 | 可進行 DLP 檢測,防止敏感資料外洩 |

| 系統可視性 | 缺乏完整 logging | 可記錄請求與回應,提升可觀測性 |

Cloudflare AI Gateway 的設計特色

從產品設計角度來看,Cloudflare AI Gateway 的核心並不僅限於請求轉發,而是著重於整體 AI 流量的治理能力。

在實務架構中,所有 AI 請求會先進入 Gateway,由系統統一進行流量控管與處理,再轉送至後端模型。這樣的設計,使企業可以掌握完整的資料流(traffic flow),並進行集中管理。

此外,該架構並不限於單一部署模式。無論企業採用地端模型或雲端 AI 服務,皆可透過相同的 Gateway 機制進行控管,確保不同環境下的 AI 使用行為具備一致性。

在安全層面,除了資料外洩防護外,也納入對 Prompt Injection 等風險的防範機制,降低模型被誘導輸出敏感資訊的可能性。

結合全球邊緣網路與在地化優勢

Cloudflare 的核心優勢在於其全球分散式網路架構。透過與既有資安能力的整合,使 AI 請求在傳輸與使用過程中,同時具備流量控管與安全檢測能力。

此外,在台灣亦有節點支援。結合邊緣運算能力,可在更接近使用者的位置進行 AI 推論,降低延遲並提升使用體驗,同時滿足資料在地化需求。

AI Gateway 將成為企業導入 AI 的標準架構

從實務觀察來看,AI Gateway 並非進階選項,而是隨著 AI 使用規模擴大後的必然需求。

多數企業在初期導入 AI 時,傾向直接串接模型 API,但當使用量成長後,往往會面臨成本、管理與資安上的壓力,最終仍需回頭補上管理層。因此,越來越多企業選擇在 AI 架構設計初期,就導入 AI Gateway,作為長期可擴展的基礎。

在實際導入過程中,如何在成本、效能與資安之間取得平衡,往往是企業規劃 AI 架構時最關注的關鍵。這也是樂雲在協助企業規劃 AI 架構時,作為顧問角色所關注的核心面向。

適用情境

Cloudflare AI Gateway 特別適用於以下場景:

- 建置企業內部 AI 助理或 Copilot

- 開發高流量 AI SaaS 產品

- 需要精準控管 AI 成本與使用行為

- 對資料安全與合規有高度要求的產業

- 跨部門共享多種 LLM 資源的企業環境

AI 的關鍵不只是模型,而是治理能力

企業導入 AI 時,焦點往往放在模型選擇,但真正影響長期效益的,是整體架構的管理能力。

AI Gateway 的價值,在於讓企業能以可控、可分析且安全的方式使用 AI,在成本、效能與風險之間取得平衡。

對於已開始擴展 AI 應用的企業而言,Cloudflare AI Gateway 將會是關鍵的基礎設施之一。

若企業在導入過程中,需要針對 AI 架構設計、成本控管或資安機制進行評估,也可以透過樂雲的顧問服務,進一步釐清適合自身業務的導入方式。